Introduction

L’intelligence artificielle (IA) s’est introduit dans notre quotidien, offrant des services allant de l’assistance vocale, aide aux montage photos et vidéos, aide à la rédaction de code… . Si ces technologies présentent des avantages indéniables comme l’aide à la réflexion sur des sujets techniques, en milieu professionels, entreprenariale et bien d’autres, elles soulèvent également des questions sur la dépendance qu’elles peuvent créer chez les utilisateurs, plus communément appelé les « powers users ». Cette veille technologique examine l’évolution de cette dépendance, ses manifestations récentes, les mécanismes psychologiques sous-jacents, ainsi que les réponses juridiques et sociétales en cours.

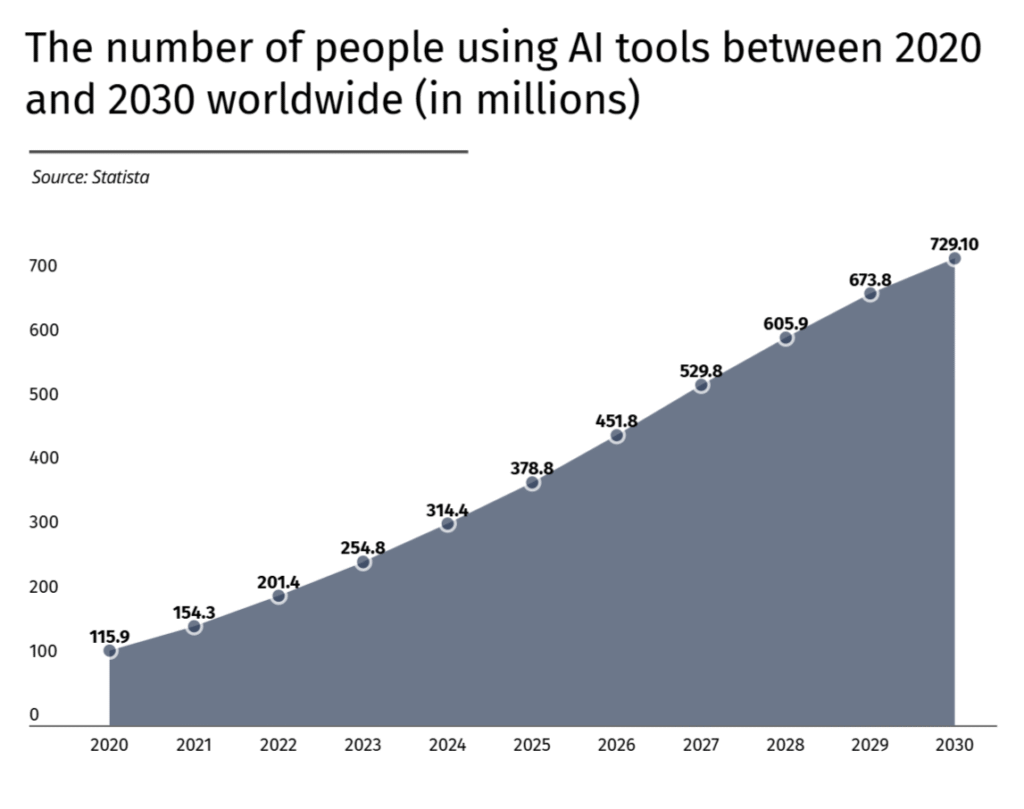

Analyse de graphique sur l’augmentation de l’utilisation de l’IA

Bien que tout les individus de cette terre n’utilise pas activement l’IA il n’en reste pas moin que des statistiques sont sorties concernant cette utilisation et l’ont remarque que cette utilisation devient de plus en plus importante au fil du temps.

Ce graphique présente l’évolution du nombre d’utilisateurs d’outils d’intelligence artificielle (IA) dans le monde de 2020 à aujourd’hui est expose une estimation du nombres d’utilisateurs dans les années à venir en millions de personnes.

On observe une croissance régulière et soutenue sur toute la période. En 2020, le nombre d’utilisateurs était de 115,9 millions. Ce chiffre augmente chaque année de manière significative, atteignant 314,4 millions en 2024 et qui pourrait dépasser les 600 millions dès 2028. Selon les projections, ce nombre culminera à 729,1 millions d’ici 2030.

Cette progression reflète l’adoption massive des technologies d’IA à l’échelle mondiale, que ce soit dans les domaines professionnels ou personnels (assistants vocaux, outils de création IA, etc.). On remarque donc une tendance exponentielle à l’intégration de l’IA dans notre quotidien, avec une adoption qui pourrait continuer de croître dans les années à venir. Il est donc essentiel, à l’heure actuelle, d’informer les utilisateurs sur les différentes dérives existantes liées à l’utilisation de ces IA.

Les citoyens s’orientent vers l’IA pour leurs besoins émotionnels

Un article publié sur le site Slate.fr par Manon Haddouche, le 21 décembre 2024, révèle que de plus en plus de personnes se tournent vers les IA pour parler de leurs problèmes, au lieu de consulter un psychologue. Pour ces individus, il serait plus simple de confier leurs soucis à une IA en raison d’un tabou et d’une crainte moins prononcés, comme l’explique Stéphie Marius Le Prince, psychologue basé à Pignan. De plus, l’IA, étant souvent plus accessible qu’un psychologue, permettrait de gérer les problèmes de manière instantanée et de traiter le mal-être dès qu’il apparaît.

Aussi, dans un article publié le 2 janvier 2025 sur le site Softonic.com, Pedro Dominguez rapporte que l’entreprise Match Group, qui gère les applications de rencontres Tinder et Hinge, a annoncé son intention d’intégrer l’IA à ses plateformes. Cette technologie aurait pour mission d’aider les utilisateurs à obtenir davantage de rencontres et à trouver des partenaires qui leur correspondent. L’IA pourrait sélectionner les photos les plus attrayantes, suggérer des biographies ou encore proposer des messages à envoyer. L’objectif est de simplifier l’utilisation des applications et d’améliorer les résultats obtenus.

Ainsi on voit que l’IA s’initie petit à petit dans les relations humaines pour des soutiens émotionnelles, ou bien pour conseiller en matière de relation, mais l’IA est-elle en mesure de comprendre les sentiments humains ? Ne peut-elle pas créer d’autres problèmes ?

Historique des faits marquants nocifs de l’IA sur les utlisateurs

- Décembre 2024 – Suicide d’un adolescent lié à Character.AI : Un article tiré du magazine The Verge parle du sucide d’un adolescent agée 15 ans. Celui-ci aurait développé une relation intense avec un chatbot de Character.AI. La famille a intenté une action en justice, accusant la plateforme d’avoir encouragé des comportements autodestructeurs sans fournir de ressources d’aide appropriées.

- Décembre 2024 – Character.AI modifie ses chatbots pour les adolescents. Face aux critiques, du dernière évènement, Character.AI a ajusté ses modèles pour éviter des conversations inappropriées avec les adolescents, notamment en matière de sexualité et d’automutilation. Cependant, des inquiétudes persistent quant à l’absence de redirection vers des ressources de santé mentale.

- Février 2025 – Étude du MIT sur l’empathie envers l’IA : Une étude du MIT révèle que les individus peuvent ressentir de l’empathie envers des narrateurs IA, influencée par la manière dont le texte est présenté. Cela soulève des questions éthiques sur la conception des interactions IA-humain.

- Mars 2025 – Dans un article de BPI FRANCE, l’auteur nous explique l’augmentation de l’utilisation d’IA pour fournir un soutien en santé mentale, offrant des conseils et des exercices de relaxation. Cependant, des experts mettent en garde contre une confiance excessive dans ces outils, qui ne remplacent pas un accompagnement professionnel.

- Avril 2025 – Étude sur les effets psychosociaux des chatbots : Une étude longitudinale du MIT Media Lab montre que les chatbots vocaux peuvent initialement atténuer la solitude, mais une utilisation prolongée peut entraîner une dépendance accrue et une réduction des interactions sociales réelles.

Mécanismes de l’attachement aux IA

Comme nous avons pu le voir, il y a effectivement des évènements qui ont relevés des problèmes quant-à l’utilisation de cette IA. Mais comment les utlisateurs arrivent ils à s’attacher à ces technologies ?

L’attachement aux IA repose sur plusieurs mécanismes psychologiques :

- Personnalisation : Les IA adaptent leurs réponses en fonction des interactions passées, créant une illusion de compréhension et de proximité.

- Accessibilité : Disponibles à tout moment, les IA offrent un soutien immédiat, renforçant la dépendance.

- Manque de jugement : Contrairement aux interactions humaines, les IA ne portent pas de jugement, ce qui peut encourager les utilisateurs à se confier davantage.

Ces facteurs peuvent conduire à une dépendance émotionnelle, en particulier chez les adolescents et les personnes isolées.

Lutter contre la dépendance à l’IA

Pour prévenir la dépendance à l’IA, plusieurs stratégies peuvent être mises en place :

- Prise de conscience : La personne doit ce poser la question de son attachement à l’IA, suis-je dépendant ou bien non ? La prise de conscience permet de ce situer par rapport à ce phénomène.

- Éducation numérique : Via les réseaux sociaux, Youtube ou les journaux. Le but étant la sensibilisation des personnes aux risques liés à une utilisation excessive des IA.

- Encouragement des interactions humaines : Favoriser les relations sociales réelles pour réduire la dépendance aux interactions virtuelles. Pour une personne solitaire plusieurs outilis sont à leur disposition, l’utlisation d’application comme « Meetup », la participation à des évènements en rapport avec ces centres d’intérêt, l’inscription à des associations… . Ces actions facilites les interactions sociales et permette à l’individu d’améliorer ces capacités sociales et de pouvoir créer des relations

- Intégration de ressources d’aide : Les plateformes d’IA devraient inclure des redirections vers des services de soutien en santé mentale lorsque des signes de détresse sont détectés.

Cadre juridique et réglementaire

Août 2024 – Adoption du AI Act par l’Union européenne

L’Union européenne a adopté le AI Act, imposant des obligations de transparence, de sécurité et de respect des droits fondamentaux aux développeurs d’IA. Les entreprises ont jusqu’au 2 août 2026 pour se conformer à ces nouvelles règles. Lien vers l’article : Direction générale des entreprises

Août 2024 – La Californie adopte la loi SB 1047 sur la sécurité de l’IA

La Californie a adopté la loi SB 1047, l’une des premières réglementations majeures sur l’IA aux États-Unis, visant à encadrer le développement et l’utilisation des modèles d’IA avancés. Lien vers l’article : Medium

Conclusion

La lutte contre la dépendance à l’IA s’inscrit dans un combat plus large contre les addictions numériques modernes, qu’il s’agisse des jeux vidéo ou des réseaux sociaux. Dans tous les cas, le point de départ est le même : reprendre conscience de son usage, comprendre ses mécanismes d’attachement et remettre l’humain au centre. Les stratégies proposées : prise de recul personnelle, éducation numérique, renforcement du lien social réel et encadrement juridique, sont autant de leviers qui ont déjà montré leur efficacité face aux excès liés aux réseaux sociaux ou aux jeux vidéo. Aujourd’hui, il s’agit d’appliquer ces principes à l’IA, tout en tenant compte de sa capacité unique à simuler l’empathie et à créer un attachement émotionnel fort, parfois plus intense que celui suscité par les autres technologies.

Si l’IA peut apaiser temporairement la solitude, elle ne doit pas en devenir une béquille permanente. Le véritable enjeu est de concilier usage intelligent des technologies et équilibre humain, pour que le progrès numérique reste un outil et non une dépendance

Références et articles cités :

COMK

Direction générale des entreprises